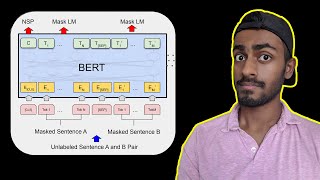

【機器學習2021】自督導式學習 (Self-supervised Learning) (二) – BERT簡介

24:14

【機器學習2021】自督導式學習 (Self-supervised Learning) (三) – BERT的奇聞軼事

32:48

【機器學習2021】Transformer (上)

28:18

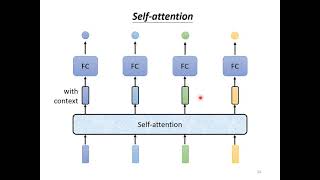

【機器學習2021】自注意力機制 (Self-attention) (上)

1:27:05

Transformer论文逐段精读

16:12

Word Embedding y Word2Vec, claramente explicado!!!

38:45

【人工智能】万字通俗讲解大语言模型内部运行原理 | LLM | 词向量 | Transformer | 注意力机制 | 前馈网络 | 反向传播 | 心智理论

9:11

Transformers, explained: Understand the model behind GPT, BERT, and T5

11:37