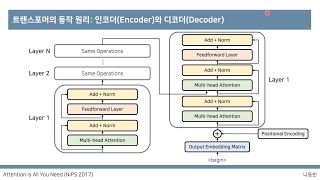

[Deep Learning 101] 트랜스포머, 스텝 바이 스텝

38:08

[Deep Learning 101] Seq2seq+Attention 코드로 챗봇을 업그레이드 합시다.

57:45

Visualizing transformers and attention | Talk for TNG Big Tech Day '24

30:02

Attention/Transformer 시각화로 설명

26:10

Attention in transformers, step-by-step | DL6

1:28:17

[딥러닝 기계 번역] Transformer: Attention Is All You Need (꼼꼼한 딥러닝 논문 리뷰와 코드 실습)

20:18

트랜스포머 2.0 등장인가... 구글, 기존 단점 제대로 극복한 새로운 AI 모델 ’Titans' 공개 | AI 칩 경쟁 판 바뀌나 | On-Device AI 시작

1:22:38

CS480/680 Lecture 19: Attention and Transformer Networks

27:14